Le traduzioni sono generate tramite traduzione automatica. In caso di conflitto tra il contenuto di una traduzione e la versione originale in Inglese, quest'ultima prevarrà.

Monitoraggio dei progressi tra le iterazioni

Puoi tenere traccia delle metriche tramite MLflow.

Nova Customization: MLFlow configurazione per SageMaker HyperPod

Per consentire all' SageMaker HyperPod ambiente di emettere le metriche MLFlow, è necessario eseguire alcune impostazioni aggiuntive.

-

Apri Amazon SageMaker AI

-

Seleziona SageMaker Studio

-

Se è già stato creato un profilo, seleziona «Open Studio».

-

Se non viene creato alcun profilo, seleziona «Crea un SageMaker dominio» per configurarne uno

-

-

Seleziona MLFlow. Se non è stata creata alcuna MLFlow app, seleziona «Crea MLFlow app»

-

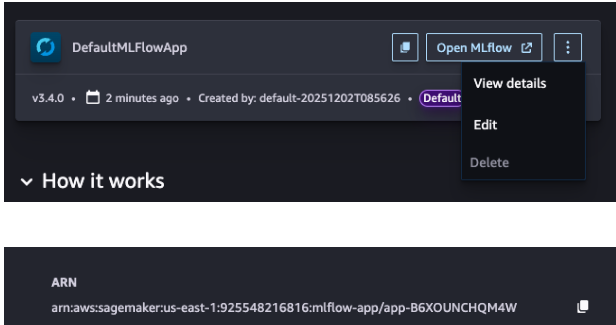

Fai clic sul copy/paste pulsante o sulla voce di menu «Visualizza dettagli» nell'app ML Flow per ottenere l'ARN. Ne avrai bisogno quando invierai il tuo lavoro di formazione.

-

Sul ruolo di esecuzione del HyperPod cluster, aggiungi la seguente politica. Ciò consentirà al HyperPod cluster di chiamare l' MLFlow API per pubblicare le metriche.

{ "Version": "2012-10-17", "Statement": [ { "Effect": "Allow", "Action": "sagemaker-mlflow:*", "Resource": [ "arn:aws:sagemaker:us-east-1:372836560492:mlflow-app/*" ] }, { "Effect": "Allow", "Action": [ "sagemaker:ListMlflowTrackingServers", "sagemaker:CallMlflowAppApi" ], "Resource": "*" } ] }

Invio di un lavoro tramite la CLI

Specificare 4 nuovi parametri di override, nella riga di comando o nella ricetta yaml.

-

mlflow_tracking_uri: L'ARN dell'app MLFlow -

mlflow_experiment_name: Il nome di questa esecuzione dell'esperimento -

mlflow_experiment_name: il nome dell'esperimento in cui verranno memorizzate le metriche MLFlow -

mlflow_run_name: Il nome di questo esperimento

Riga di comando

--override-parameters '{"recipes.run.mlflow_tracking_uri": "arn:aws:sagemaker:us-east-1:925548216816:mlflow-app/app-B6XOUNCHQM4W", "recipes.run.mlflow_experiment_name": "myuser-sft-lora-exp1", "recipes.run.mlflow_run_name": "myuser-sft-lora-exp1-202512181940"}'

yaml:

## Run config run: mlflow_tracking_uri: "arn:aws:sagemaker:us-east-1:925548216816:mlflow-app/app-B6XOUNCHQM4W" mlflow_experiment_name: "myuser-sft-lora-exp1" mlflow_run_name: "myuser-sft-lora-exp1-202512181940"

Invio di un lavoro tramite l'interfaccia utente di Studio SageMaker

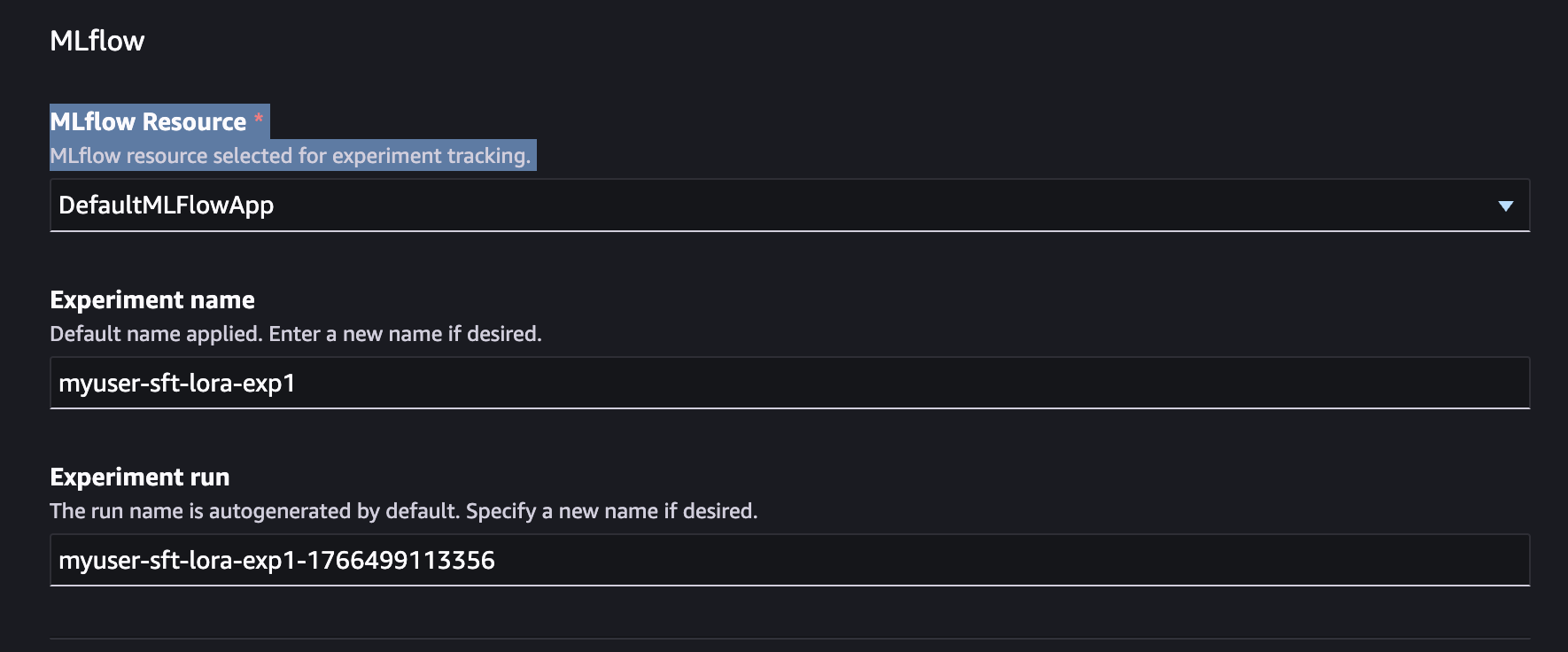

MLFlow l'integrazione è già integrata nell'esperienza dell'interfaccia utente di SageMaker Studio. Quando invii un lavoro di formazione, indica semplicemente quale istanza MLFlow dell'app utilizzare.

-

In SageMaker Studio, accedi a Modelli > Nova 2.0 Lite > Personalizza > Personalizza con interfaccia utente.

-

Espandi la sezione Configurazione avanzata

-

Seleziona l' MLFlow app a cui desideri inviare le metriche di allenamento. Puoi anche impostare il nome dell'esperimento e l'esecuzione dell'esperimento qui.

Invio di un lavoro tramite AWS CLI

Se utilizzi il AWS CLI, devi creare un' MLflow app e passarla come input alla richiesta API di training job.

mlflow_app_name="<enter your MLflow app name>" role_arn="<enter your role ARN>" bucket_name="<enter your bucket name>" region="<enter your region>" mlflow_app_arn=$(aws sagemaker create-mlflow-app \ --name $mlflow_app_name \ --artifact-store-uri "s3://$bucket_name" \ --role-arn $role_arn \ --region $region)

Crea un' MLflow app

Utilizzo dell'interfaccia utente di Studio: se crei un lavoro di formazione tramite l'interfaccia utente di Studio, viene creata automaticamente MLflow un'app predefinita e selezionata per impostazione predefinita in Opzioni avanzate.

Utilizzo della CLI: se utilizzi la CLI, devi creare un' MLflow app e passarla come input alla richiesta API del lavoro di formazione.

mlflow_app_name="<enter your MLflow app name>" role_arn="<enter your role ARN>" bucket_name="<enter your bucket name>" region="<enter your region>" mlflow_app_arn=$(aws sagemaker create-mlflow-app \ --name $mlflow_app_name \ --artifact-store-uri "s3://$bucket_name" \ --role-arn $role_arn \ --region $region)

Accedi all'app MLflow

Utilizzo della CLI: crea un URL prefirmato per accedere all'interfaccia utente dell' MLflow app:

aws sagemaker create-presigned-mlflow-app-url \ --arn $mlflow_app_arn \ --region $region \ --output text

Utilizzo dell'interfaccia utente di Studio: l'interfaccia utente di Studio mostra le metriche chiave archiviate MLflow e fornisce un collegamento all'interfaccia utente dell' MLflow app.

Metriche chiave da monitorare

Monitora queste metriche tra le iterazioni per valutare i miglioramenti e monitorare l'avanzamento del lavoro:

Per SFT

-

Curve di perdita in allenamento

-

Numero di campioni consumati e tempo di elaborazione dei campioni

-

Precisione delle prestazioni su set di test esauriti

-

Conformità del formato (ad esempio, velocità di output JSON valida)

-

Perplessità sui dati di valutazione specifici del dominio

Per RFT

-

Punteggi medi di ricompensa rispetto agli allenamenti

-

Distribuzione dei premi (percentuale di risposte ad alto rendimento)

-

Tendenze relative ai premi di convalida (attenzione all'overfit)

-

Percentuali di successo specifiche delle attività (ad esempio, velocità di esecuzione del codice, precisione dei problemi matematici)

Ambito generale

-

Effettua il benchmark dei delta prestazionali tra le iterazioni

-

Punteggi di valutazione umana su campioni rappresentativi

-

Metriche di produzione (se implementate in modo iterativo)

Determinare quando fermarsi

Interrompi l'iterazione quando:

-

Livelli prestazionali: la formazione aggiuntiva non migliora più in modo significativo le metriche target

-

Il cambio di tecnica aiuta: se una tecnica si stabilizza, prova a cambiarla (ad esempio, SFT → RFT → SFT) per superare i limiti prestazionali

-

Metriche obiettivo raggiunte: i tuoi criteri di successo sono soddisfatti

-

Regressione rilevata: le nuove iterazioni riducono le prestazioni (vedi le procedure di rollback di seguito)

Per le procedure di valutazione dettagliate, consulta la sezione Valutazione.