Supervisión del progreso en las iteraciones

Puede hacer un seguimiento de las métricas a través de MLflow.

Personalización de Nova: configuración de MLflow para SageMaker HyperPod

Para permitir que el entorno de SageMaker HyperPod envíe métricas a MLflow, es necesario realizar una configuración adicional.

-

Abra Amazon SageMaker AI.

-

Seleccione SageMaker Studio.

-

Si ya hay un perfil creado, seleccione Abrir Studio.

-

Si no hay ningún perfil creado, seleccione Crear un dominio de SageMaker para configurar uno.

-

-

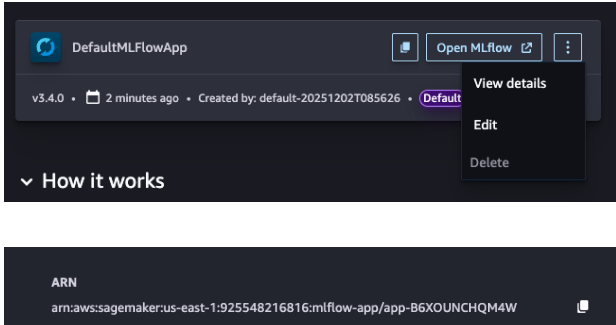

Seleccione MLflow. Si no hay ninguna aplicación MLflow creada, seleccione Crear aplicación de MLflow.

-

Haga clic en el botón de copiar/pegar o en el elemento del menú Ver detalle de la aplicación MLflow para obtener el ARN. Lo necesitará cuando envíe su trabajo de entrenamiento.

-

En el rol de puesta en marcha del clúster de HyperPod, agregue la siguiente política. Esto permitirá que el clúster de HyperPod llame a la API de MLflow para publicar métricas.

{ "Version": "2012-10-17", "Statement": [ { "Effect": "Allow", "Action": "sagemaker-mlflow:*", "Resource": [ "arn:aws:sagemaker:us-east-1:372836560492:mlflow-app/*" ] }, { "Effect": "Allow", "Action": [ "sagemaker:ListMlflowTrackingServers", "sagemaker:CallMlflowAppApi" ], "Resource": "*" } ] }

Envío de un trabajo a través de la CLI

Especifique 4 nuevos parámetros de anulación, ya sea en la línea de comandos o en la fórmula yaml.

-

mlflow_tracking_uri: el ARN de la aplicación MLflow -

mlflow_experiment_name: el nombre de la característica de este experimento. -

mlflow_experiment_name: el nombre del experimento en el que se almacenarán las métricas en MLflow. -

mlflow_run_name: el nombre de este experimento.

Línea de comandos

--override-parameters '{"recipes.run.mlflow_tracking_uri": "arn:aws:sagemaker:us-east-1:925548216816:mlflow-app/app-B6XOUNCHQM4W", "recipes.run.mlflow_experiment_name": "myuser-sft-lora-exp1", "recipes.run.mlflow_run_name": "myuser-sft-lora-exp1-202512181940"}'

yaml:

## Run config run: mlflow_tracking_uri: "arn:aws:sagemaker:us-east-1:925548216816:mlflow-app/app-B6XOUNCHQM4W" mlflow_experiment_name: "myuser-sft-lora-exp1" mlflow_run_name: "myuser-sft-lora-exp1-202512181940"

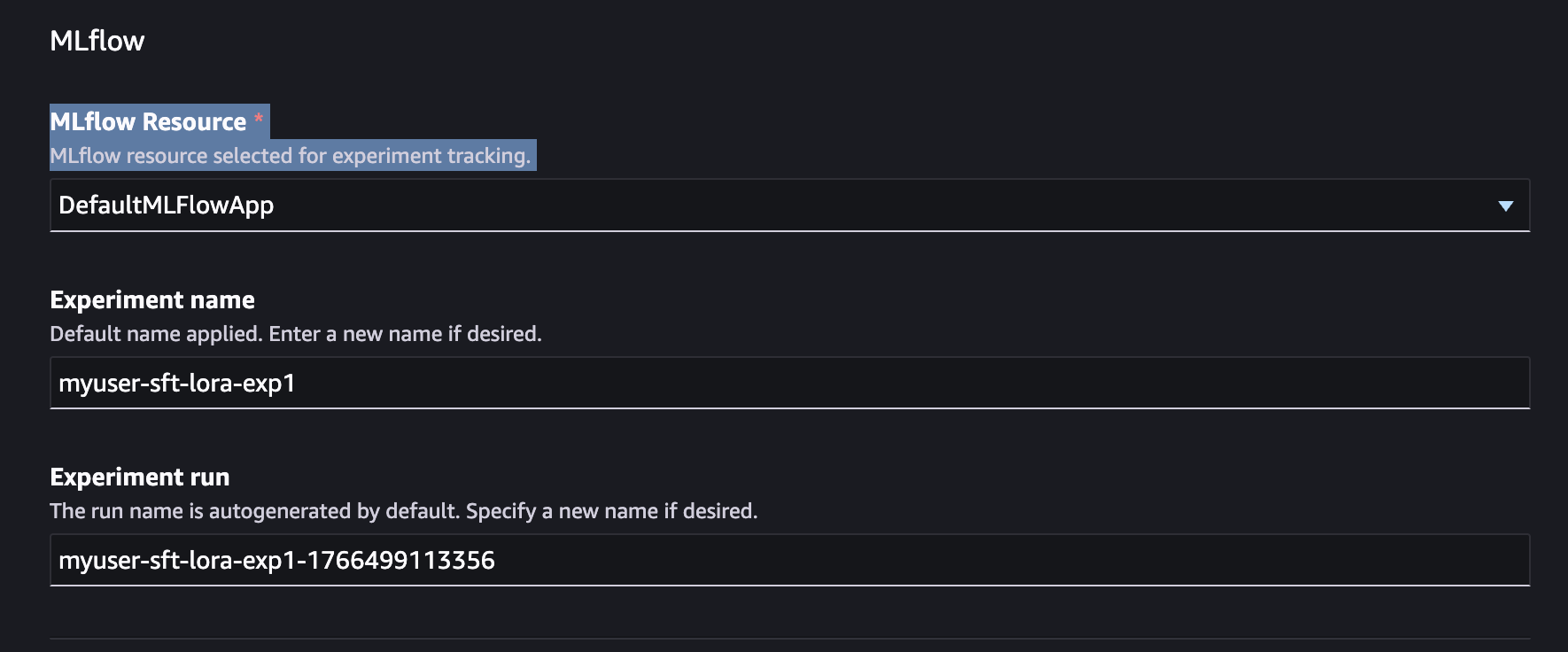

Envío de un trabajo a través de la interfaz de usuario de SageMaker Studio

La integración de MLflow ya forma parte de la experiencia de la interfaz de usuario de SageMaker Studio. Al enviar un trabajo de entrenamiento, simplemente indique qué instancia de la aplicación MLFlow va a utilizar.

-

En SageMaker Studio, vaya a Modelos > Nova 2.0 Lite > Personalizar > Personalizar con interfaz de usuario.

-

Amplíe la sección Configuración avanzada.

-

Seleccione la aplicación MLflow a la que desee enviar las métricas de entrenamiento. También puede indicar el nombre del experimento y configurar su puesta en marcha aquí.

Envío de un trabajo a través de la AWS CLI

Si utiliza la AWS CLI, debe crear una aplicación MLflow y pasarla como entrada a la solicitud de la API del trabajo de entrenamiento.

mlflow_app_name="<enter your MLflow app name>" role_arn="<enter your role ARN>" bucket_name="<enter your bucket name>" region="<enter your region>" mlflow_app_arn=$(aws sagemaker create-mlflow-app \ --name $mlflow_app_name \ --artifact-store-uri "s3://$bucket_name" \ --role-arn $role_arn \ --region $region)

Creación de una aplicación MLflow

Uso de la interfaz de usuario de Studio: si crea un trabajo de entrenamiento a través de la interfaz de usuario de Studio, se crea automáticamente una aplicación MLflow predeterminada que se selecciona por defecto en Opciones avanzadas.

Uso de la CLI: si usa la CLI, debe crear una aplicación MLflow y pasarla como entrada a la solicitud de la API del trabajo de entrenamiento.

mlflow_app_name="<enter your MLflow app name>" role_arn="<enter your role ARN>" bucket_name="<enter your bucket name>" region="<enter your region>" mlflow_app_arn=$(aws sagemaker create-mlflow-app \ --name $mlflow_app_name \ --artifact-store-uri "s3://$bucket_name" \ --role-arn $role_arn \ --region $region)

Acceso a la aplicación MLflow

Uso de la CLI: cree una URL prefirmada para acceder a la interfaz de usuario de la aplicación MLflow:

aws sagemaker create-presigned-mlflow-app-url \ --arn $mlflow_app_arn \ --region $region \ --output text

Uso de la interfaz de usuario de Studio: la interfaz de usuario de Studio muestra las métricas clave almacenadas en MLflow y proporciona un enlace a la interfaz de usuario de la aplicación MLflow.

Métricas clave para hacer un seguimiento

Supervise estas métricas en las iteraciones para evaluar la mejora y hacer un seguimiento del progreso del trabajo:

Para SFT

-

Curvas de pérdidas de entrenamiento

-

Número de muestras consumidas y tiempo de procesamiento

-

Precisión del rendimiento en conjuntos de prueba reservados

-

Cumplimiento del formato (por ejemplo, velocidad de salida JSON válida)

-

Perplejidad en datos de evaluación específicos del dominio

Para RFT

-

Puntuaciones promedio de recompensa durante el entrenamiento

-

Distribución de las recompensas (porcentaje de respuestas con alta recompensa)

-

Tendencias de la recompensa en validación (atención al sobreajuste)

-

Tasas de éxito específicas por tarea (por ejemplo, tasa de aprobación en procesamiento de código, precisión en problemas matemáticos)

General

-

Diferencias de rendimiento en pruebas comparativas entre iteraciones

-

Puntuaciones de evaluación humana en muestras representativas

-

Métricas de producción (si se realiza una implementación iterativa)

Cómo determinar cuándo parar

Deje de iterar en los siguientes casos:

-

Rendimiento estancado: el entrenamiento adicional ya no mejora significativamente las métricas objetivo

-

Cambio de técnica para seguir progresando: si una técnica se estanca, pruebe a cambiarla (p. ej., SFT → RFT → SFT) para superar los límites de rendimiento

-

Métricas objetivo alcanzadas: se cumplen sus criterios de rendimiento correcto.

-

Regresión detectada: las nuevas iteraciones reducen el rendimiento (consulte los procedimientos de reversión que aparecen a continuación)

Para obtener información detallada sobre los procedimientos de evaluación, consulte la sección Evaluación.