Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

Überwachung des Fortschritts über Iterationen hinweg

Sie können Metriken verfolgen über MLflow.

Nova Customization — MLFlow Einrichtung für SageMaker HyperPod

Damit Ihre SageMaker HyperPod Umgebung Metriken ausgeben kann MLFlow, müssen Sie einige zusätzliche Einstellungen vornehmen.

-

Öffnen Sie Amazon SageMaker AI

-

Wählen Sie SageMaker Studio

-

Wenn bereits ein Profil erstellt wurde, wählen Sie „Studio öffnen“.

-

Wenn kein Profil erstellt wurde, wählen Sie „Eine SageMaker Domain erstellen“, um eines einzurichten

-

-

Wählen Sie MLFlow. Wenn keine MLFlow App erstellt wurde, wählen Sie „ MLFlow App erstellen“

-

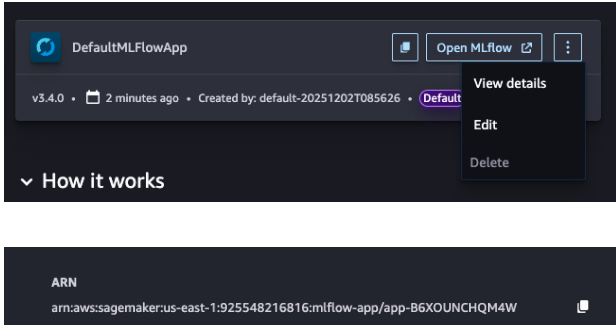

Klicken Sie in der ML Flow App auf die copy/paste Schaltfläche oder den Menüpunkt „Details anzeigen“, um den ARN abzurufen. Sie benötigen dies, wenn Sie Ihren Ausbildungsjob einreichen.

-

Fügen Sie der HyperPod Cluster-Ausführungsrolle die folgende Richtlinie hinzu. Dadurch kann der HyperPod Cluster die MLFlow API aufrufen, um Metriken zu veröffentlichen.

{ "Version": "2012-10-17", "Statement": [ { "Effect": "Allow", "Action": "sagemaker-mlflow:*", "Resource": [ "arn:aws:sagemaker:us-east-1:372836560492:mlflow-app/*" ] }, { "Effect": "Allow", "Action": [ "sagemaker:ListMlflowTrackingServers", "sagemaker:CallMlflowAppApi" ], "Resource": "*" } ] }

Einen Job über die CLI einreichen

Geben Sie 4 neue Override-Parameter an, entweder in der Befehlszeile oder im Rezept yaml.

-

mlflow_tracking_uri: Der ARN der MLFlow App -

mlflow_experiment_name: Der Name für diesen Durchlauf des Experiments -

mlflow_experiment_name: Der Name des Experiments, in dem die Metriken gespeichert werden MLFlow -

mlflow_run_name: Der Name für dieses Experiment

Befehlszeile

--override-parameters '{"recipes.run.mlflow_tracking_uri": "arn:aws:sagemaker:us-east-1:925548216816:mlflow-app/app-B6XOUNCHQM4W", "recipes.run.mlflow_experiment_name": "myuser-sft-lora-exp1", "recipes.run.mlflow_run_name": "myuser-sft-lora-exp1-202512181940"}'

yaml:

## Run config run: mlflow_tracking_uri: "arn:aws:sagemaker:us-east-1:925548216816:mlflow-app/app-B6XOUNCHQM4W" mlflow_experiment_name: "myuser-sft-lora-exp1" mlflow_run_name: "myuser-sft-lora-exp1-202512181940"

Einen Job über die SageMaker Studio-Benutzeroberfläche einreichen

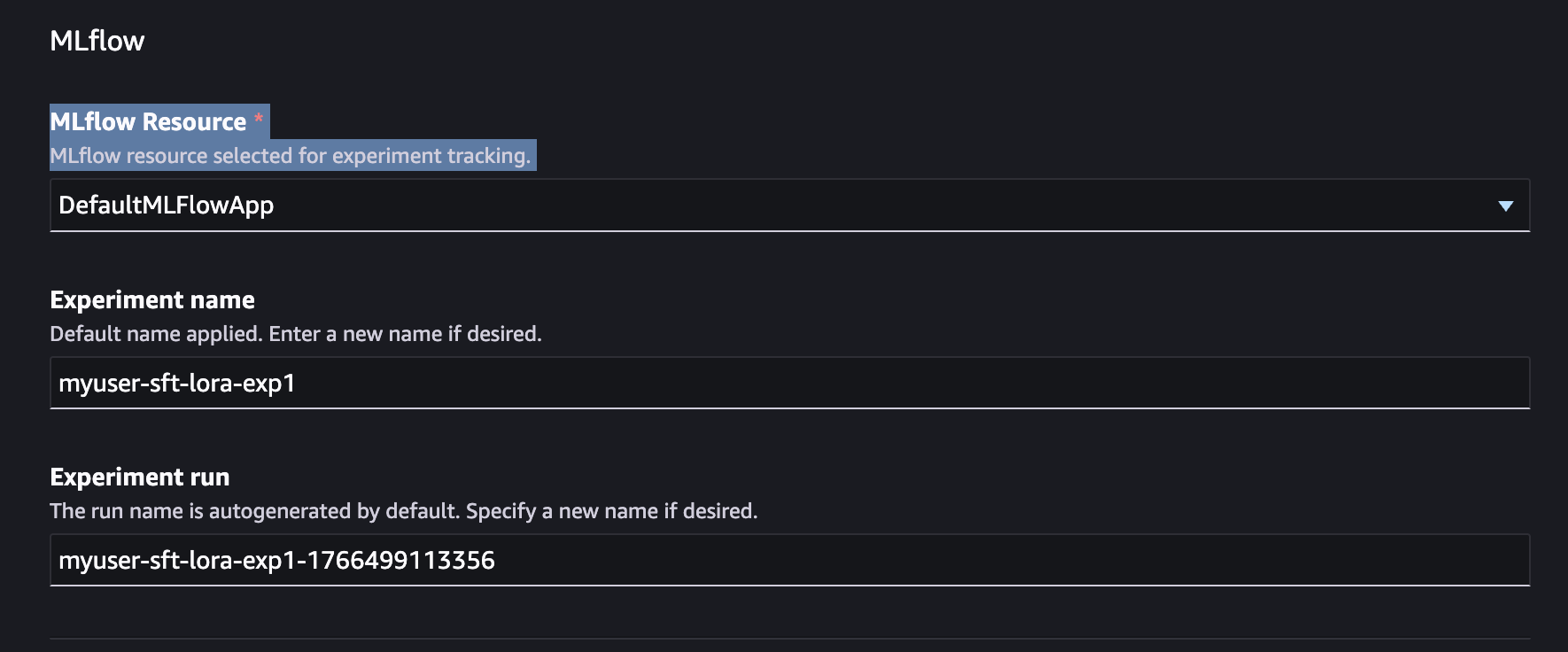

MLFlow Die Integration ist bereits in die SageMaker Studio-Benutzeroberfläche integriert. Geben Sie beim Einreichen eines Schulungsjobs einfach an, welche MLFlow App-Instanz verwendet werden soll.

-

Navigieren Sie in SageMaker Studio zu Modelle > Nova 2.0 Lite > Anpassen > Mit UI anpassen.

-

Erweitern Sie den Abschnitt Erweiterte Konfiguration

-

Wählen Sie die MLFlow App aus, an die Sie die Trainingsmetriken senden möchten. Sie können hier auch den Namen Ihres Experiments festlegen und das Experiment ausführen.

Einreichen eines Jobs über AWS CLI

Wenn Sie die verwenden AWS CLI, müssen Sie eine MLflow App erstellen und sie als Eingabe für die API-Anfrage für den Schulungsjob übergeben.

mlflow_app_name="<enter your MLflow app name>" role_arn="<enter your role ARN>" bucket_name="<enter your bucket name>" region="<enter your region>" mlflow_app_arn=$(aws sagemaker create-mlflow-app \ --name $mlflow_app_name \ --artifact-store-uri "s3://$bucket_name" \ --role-arn $role_arn \ --region $region)

Erstellen Sie eine MLflow App

Verwenden der Studio-Benutzeroberfläche: Wenn Sie einen Schulungsjob über die Studio-Benutzeroberfläche erstellen, wird automatisch eine MLflow Standard-App erstellt und standardmäßig unter Erweiterte Optionen ausgewählt.

CLI verwenden: Wenn Sie die CLI verwenden, müssen Sie eine MLflow App erstellen und sie als Eingabe an die API-Anfrage für den Trainingsjob übergeben.

mlflow_app_name="<enter your MLflow app name>" role_arn="<enter your role ARN>" bucket_name="<enter your bucket name>" region="<enter your region>" mlflow_app_arn=$(aws sagemaker create-mlflow-app \ --name $mlflow_app_name \ --artifact-store-uri "s3://$bucket_name" \ --role-arn $role_arn \ --region $region)

Greifen Sie auf die MLflow App zu

Verwenden von CLI: Erstellen Sie eine vorsignierte URL für den Zugriff auf die MLflow App-Benutzeroberfläche:

aws sagemaker create-presigned-mlflow-app-url \ --arn $mlflow_app_arn \ --region $region \ --output text

Verwenden der Studio-Benutzeroberfläche: Die Studio-Benutzeroberfläche zeigt wichtige Kennzahlen an, die in der App-Benutzeroberfläche gespeichert sind, MLflow und bietet einen Link zur MLflow App-Benutzeroberfläche.

Wichtige Kennzahlen, die es zu verfolgen gilt

Überwachen Sie diese Kennzahlen in allen Iterationen, um die Verbesserung zu bewerten und den Arbeitsfortschritt zu verfolgen:

Für SFT

-

Verlustkurven beim Training

-

Anzahl der verbrauchten Proben und Zeit für die Probenverarbeitung

-

Leistungsgenauigkeit bei ausgestreckten Testgeräten

-

Formatkonformität (z. B. gültige JSON-Ausgaberate)

-

Unklarheit in Bezug auf domänenspezifische Bewertungsdaten

Für RFT

-

Durchschnittliche Belohnungspunktzahlen im Vergleich zum Training

-

Verteilung der Prämien (Prozentsatz der Antworten mit hoher Prämie)

-

Trends bei der Validierung von Prämien (achten Sie auf zu hohe Anforderungen)

-

Aufgabenspezifische Erfolgsquoten (z. B. Erfolgsquote bei der Codeausführung, Genauigkeit mathematischer Probleme)

General

-

Vergleichen Sie Leistungsdeltas zwischen Iterationen

-

Bewertungsergebnisse am Menschen anhand repräsentativer Stichproben

-

Produktionskennzahlen (bei iterativer Bereitstellung)

Feststellen, wann gestoppt werden soll

Beenden Sie die Iteration, wenn:

-

Leistungsplateaus: Zusätzliche Schulungen verbessern die Zielkennzahlen nicht mehr nennenswert

-

Technikwechsel hilft: Wenn bei einer Technik ein Plateau auftritt, versuchen Sie, zu wechseln (z. B. SFT → RFT → SFT), um die Leistungsobergrenzen zu durchbrechen

-

Erreichte Zielkennzahlen: Ihre Erfolgskriterien sind erfüllt

-

Regression erkannt: Neue Iterationen verschlechtern die Leistung (siehe Rollback-Verfahren unten)

Ausführliche Bewertungsverfahren finden Sie im Abschnitt Bewertung.